"내 대화가 다 노출됐다" 이루다 사태, 이번엔 개인정보 논란

비공개

0

368

0

0

2021.01.14 22:02

비공개

0

368

0

0

2021.01.14 22:02

스캐터랩 2차 사과문 발표에도 논란 확산

인공지능(AI) 챗봇 '이루다' 개발사인 스캐터랩이 개인정보 활용 과정에서 빚어진 논란과 관련해 "이용자들과 충분히 소통하지 못했다"며 2차 사과문을 냈다. 당시 이용자들에게 개인정보 이용 동의를 받아 법적 문제는 예상하지 못했다는 해명인데, 이용자들은 "돈 내고 개인정보를 판 기분이다"며 단체행동까지 예고, 논란은 더 확산되고 있다.

내 카톡이 AI 학습자료?…"신규 서비스 개발에 이용된다"는 회사 규정이 유일 근거

스캐터랩은 13일 저녁 이틀 만에 "뼈를 깎는 노력으로 보완하겠다"는 내용의 2차 사과문을 발표했다. 스캐터랩은 이루다를 둘러싼 각종 잡음이 불거지자 최근 서비스 잠정 중단 결정을 내렸지만 오히려 후폭풍만 커세지는 모양새다. 회사 측이 이용자의 은밀한 사적 개인정보를 무분별하게 활용했다는 문제제기가 쏟아지면서다.

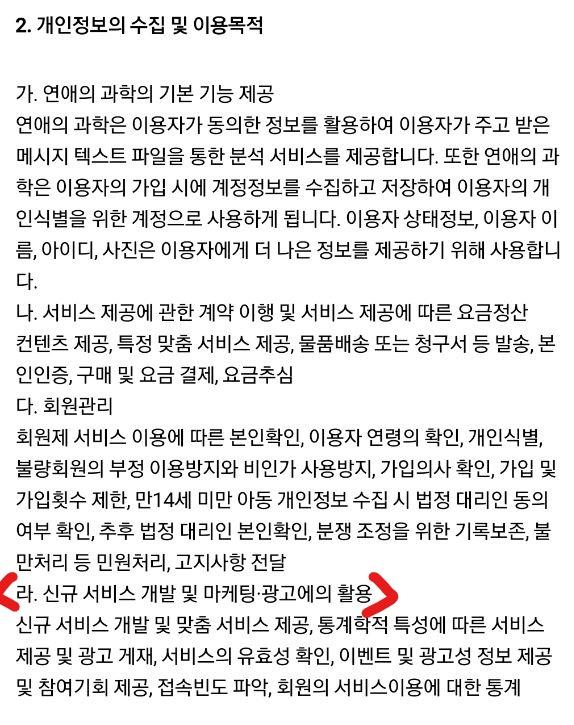

이루다는 100억건의 카카오톡 메시지를 학습해 탄생했다. 이 카톡 데이터는 스캐터랩에서 선보인 '연예의 과학'이란 응용 소프트웨어(앱)에서 가져온 것이다. 오직 카톡 대화만을 학습한 이루다는 정식 출시 이후 카톡 대화 내용에 포함된 실명, 주소, 계좌 등 민감한 사적 정보를 대거 언급하면서 개인정보 유출, 동의없이 카톡 메시지를 활용했다는 논란 등으로 번졌다. 여기에 스캐터랩이 정보기술(IT) 개발자들이 오픈소스를 공유하는 '깃허브'(GitHub)에 이루다의 기술 모델을 소개하면서 익명화 작업이 덜 된 '카톡 데이터' 일부를 포함한 사실이 드러나면서 뒤늦게 도마에 오르고 있다. 스캐터랩 개인정보 활용 규정 전문에 소개된 내용. 라항에 신규서비스 개발에 개인정보를 활용할 수 있다고 돼 있다.

스캐터랩 개인정보 활용 규정 전문에 소개된 내용. 라항에 신규서비스 개발에 개인정보를 활용할 수 있다고 돼 있다.

스캐터랩은 2차 사과문에서 개인정보 활용 논란과 관련해 "내부적으로 법적 문제는 없을 걸로 판단했다"고 해명했다. 연예의 과학 앱 이용자들에게 '개인정보 수집과 이용'에 관한 동의를 받기도 했고 회사의 개인정보 처리 규정에 수집된 정보가 '신규 서비스 개발과 마케팅에 이용될 수 있다'는 단서가 달려 있는 만큼 법적 문제를 예상하지 못했다는 것이다. 깃허브 논란은 "특정인을 추정할 여지는 전혀 없다"고 해명했다. 개별적인 대화 메시지만 포함돼 '개인정보 유출'과는 거리가 멀다는 취지다.

"연인과의 대화가 AI 입에서 나온다 생각하니 분노"

하지만 회사측 해명은 도리어 이용자들 분노에 불을 지른 셈이 됐다. 연예의 과학 게시판엔 최근 매일 수십건의 항의글이 쏟아지고 있다. 한 이용자는 "카톡 대화를 토대로 과학적 분석을 해준다고 해서 서비스에 응한 건데 가장 사적인 연인과의 카톡 대화가 AI 학습에 이용되는 건 물론이고 AI 입에서 연인과 나눈 대화가 나온다는 사실에 충격을 받았다"고 꼬집었다. 현재 연애의 과학 이용자들은 400여명 규모의 오픈 채티방까지 개설해 집단 소송을 준비 중이다. 연예의 과학 게시판엔 매일 수십건의 항의글이 쏟아지고 있다.

연예의 과학 게시판엔 매일 수십건의 항의글이 쏟아지고 있다.

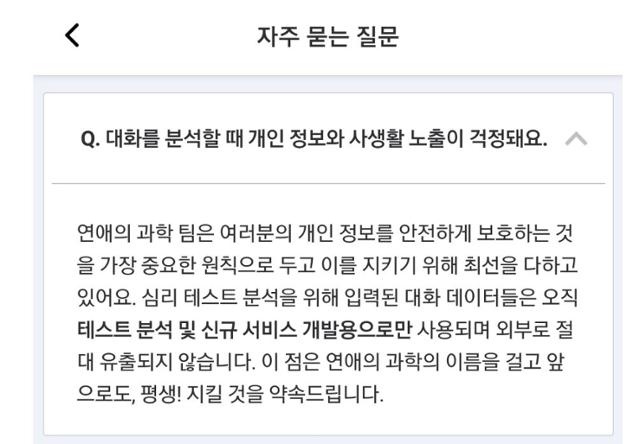

이용자들 주장처럼 회사가 개인정보를 무분별하게 사용한 측면이 없지 않다. 스캐터랩은 '자주 묻는 질문' 게시판에서 '개인정보 노출이 걱정된다' 질문에 "데이터는 오직 테스트 분석과 신규 서비스 개발용으로만 사용돼 외부로 절대 유출되지 않는다"고 써놨는데, 정작 누구도 신규 서비스가 'AI 챗봇'이란 사실을 알지 못했다. 더구나 회사 규정엔 '정보수집 이전에 이용자에게 비즈니스 파트너가 누구이며, 언제까지 정보를 활용하는지 동의를 구하는 절차를 거친다'고 돼 있지만, 이 역시 따르지 않았다.

정부까지 조사 나섰다…법조계선 법 위반 가능성

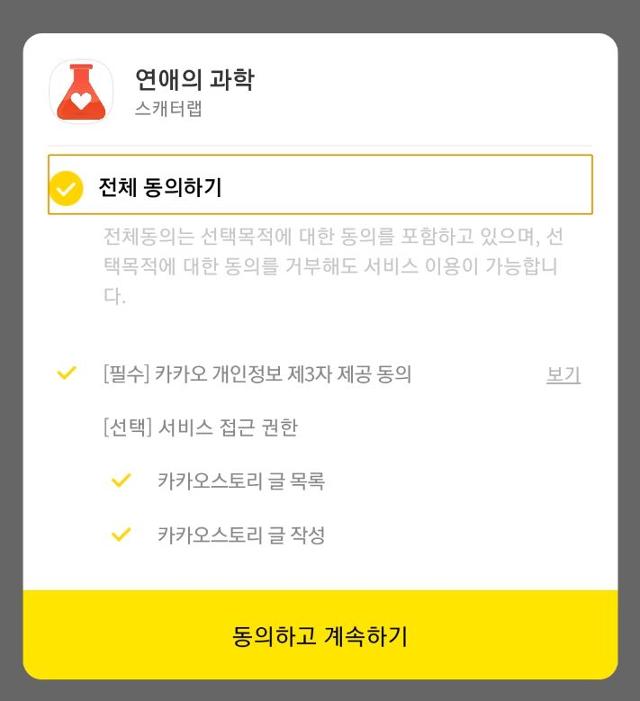

논란이 확산되면서 정부기관인 개인정보보호위원회도 스캐터랩을 상대로 개인정보 수집과 활용에 문제가 없었는지 조사 중이다. 배상호 개인정보위 과장은 이에 대해 "정보주체에게 신규 서비스에 대한 개인정보 활용 동의를 제대로 구했는지를 중점적으로 살피고 있다"고 말했다. 연예의 과학 첫 화면. 회사는 이를 근거로 개인정보 활용에 문제가 없었다고 판단했다고 해명했다. (사진=캡처)

연예의 과학 첫 화면. 회사는 이를 근거로 개인정보 활용에 문제가 없었다고 판단했다고 해명했다. (사진=캡처)

법조계에서도 '개인정보보호법' 위반 가능성에 무게를 두고 있는 분위기다. 단순히 초기 화면에서 형식적으로 전체동의를 받은 걸 근거로 다른 서비스 대한 개인정보 활용 권리까지 얻었다고 보긴 어렵다는 판단에서다. 정부 조사에서 개인정보를 소홀히 다룬 게 인정되면 과징금과 과태료, 시정명령 등의 조치가 뒤따른다. AI 챗봇이 이제 막 태동하는 시기인 만큼 신중해야 한다는 지적도 없지 않다. 장병탁 서울대 AI연구원장은 "데이터 확보 등에 대한 기준을 엄밀히 정해야지 서비스 자체를 없애라는 식으로 논의를 이어가는 건 바람직하지 않다"고 말했다.

한편 방송통신위원회는 14일 최근 AI 윤리 문제 등이 부상하자 이용자 보호원칙이 지켜질 수 있도록 AI 유닐 규범 등을 구체화하는 식의 제도개선을 추진하겠다고 밝혔다.

김동욱 기자 kdw1280@hankookilbo.com

ㅡㅡ지우지 말아 주세요 ㅡㅡ

온라인카지노 커뮤니티 일등!! 온카 https://casinoleak.com

북기기

북기기 보헤미안

보헤미안 streem

streem 비트팟

비트팟 모스코스

모스코스 마법사

마법사 비노

비노 이실장

이실장 오잉

오잉 아이리스

아이리스 겨울엔오사카로

겨울엔오사카로 스트롱맨

스트롱맨